Conteúdo Atualizado em 3 de agosto de 2025 por felipecferreira, enjoy!

Com petabytes de dados sendo gerados por satélites, está cada vez mais difícil transformar essa “enxurrada” de imagens em informações acionáveis (legitimamente úteis).

Dados em excesso e rótulos de qualidade escassa são o paradoxo atual da geociência.

A DeepMind propõe então resolver isso com uma abordagem bastante ousada: AlphaEarth Foundations, um modelo de “embedding field” que promete redefinir a maneira como mapeamos o planeta Terra.

Você pode acessar o paper na íntegra, clicando aqui.

Por que isso importa: o desafio de transformar observações em conhecimento

Se você trabalha com monitoramento ambiental, gestão de recursos naturais, agricultura de precisão ou planejamento urbano, sabe que os mapas são instrumentos decisivos para tomada de decisão.

O problema é que dados não são mapas.

Mesmo com imagens diárias de satélites como Sentinel-2 ou Landsat-9, a maior parte dos modelos de mapeamento depende de observações pontuais ou rótulos localizados.

Ou seja: sabemos pouco sobre muito.

O AlphaEarth Foundations (AEF) ataca justamente esse problema:

Como gerar representações universais, generalistas e compactas do planeta, mesmo com poucos rótulos?

O que é o AlphaEarth Foundations, na prática?

O AEF é um modelo de featurização de imagens de observação da Terra (EO) que gera campos de embedding com alta resolução espacial (10m) e informativamente densos.

Esses embeddings funcionam como uma espécie de “resumo codificado” do planeta em um dado intervalo de tempo, permitindo inferências, predições e aplicações em diversos domínios.

O que diferencia o AEF de outras abordagens anteriores, como SatCLIP, Clay, Prithvi ou MOSAIKS, é que ele:

- Lida com tempo como variável contínua;

- Suporta múltiplas fontes de dados (Sentinel, GEDI, GRACE, Wikipedia, etc);

- Usa um encoder chamado STP (Space Time Precision) que combina autoatenção temporal e espacial com convoluções e pirâmides laplacianas;

- Gera representacoes compactas: cada embedding tem apenas 64 bytes;

- Alinha embeddings com textos e metadados para usos multimodais.

Visualizando o AlphaEarth Foundations na prática

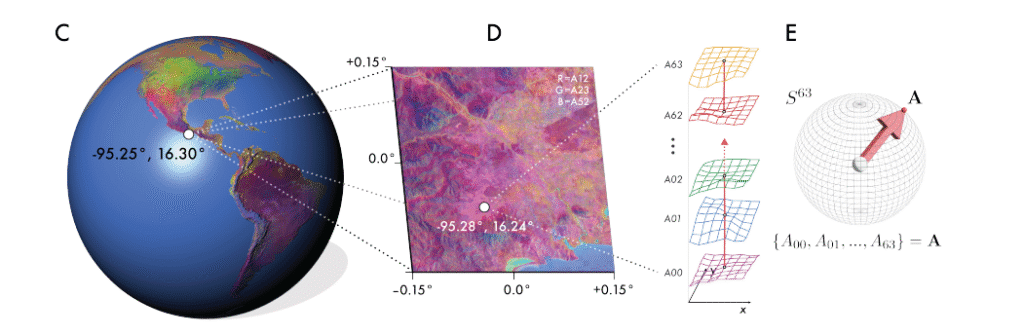

A imagem abaixo nos ajuda a entender como o AlphaEarth Foundations (AEF) transforma imagens de satélite em representações vetoriais úteis para análise e inferência.

C — Visão global

A Terra é representada com cores derivadas dos vetores do modelo AEF para o ano de 2023. Mesmo em escala planetária, é possível perceber padrões climáticos e ecológicos, como se estivéssemos vendo não só o planeta, mas uma espécie de “assinatura vetorial da paisagem”.

D — Resolução local

Ao dar zoom em uma região de Oaxaca, no México, vemos que o modelo trabalha com resolução de até 10 metros quadrados por pixel, uma granularidade altíssima. Cada cor dessa imagem representa uma combinação de três dimensões específicas do vetor de embedding: A12 (vermelho), A23 (verde) e A52 (azul).

E — Campo vetorial embutido

Cada pixel da imagem é, na verdade, um vetor de 64 dimensões (chamadas A0 a A63). Juntas, essas dimensões formam o chamado campo de embedding, onde cada vetor é um ponto no espaço de uma esfera unitária de 63 dimensões. Essa representação abstrata permite que algoritmos simples, como k-NN (K-Nearest Neighbors) ou regressão linear, façam inferências complexas sobre uso do solo, clima ou vegetação.

Exemplos de aplicação: do agro à biodiversidade

A equipe da DeepMind desenvolveu uma suite de 15 testes práticos com datasets reais e variados, como:

- Classificação de uso e cobertura da terra (LCMAP, GLaNCE);

- Identificação de culturas agrícolas na África e no Canadá;

- Detecção de mudança de uso da terra (ex: desmatamento);

- Estimação de variáveis biofísicas como evapotranspiração e emissividade.

O modelo superou todos os benchmarks em todos os cenários: desde situações com 300 exemplos por classe até casos extremos de few-shot learning (com apenas 1 ou 10 amostras).

Na prática, isso significa que é possível aplicar modelos simples (como k-NN ou regressão linear) diretamente sobre os embeddings, com resultados superiores aos obtidos com outros métodos mais complexos.

Simplesmente um Show! s2

Dataset Global de Embeddings: acesso público e pronto para uso

Para facilitar a adoção, a DeepMind liberou os campos de embedding anuais de 2017 a 2024 através do Google Earth Engine.

Cada layer representa um “mapa comprimido” com representações vetoriais que podem ser usados diretamente por pesquisadores e profissionais de diferentes áreas.

O modelo também foi otimizado para ser leve e acessível: os embeddings são quantizados para 8 bits (sem perda significativa de qualidade), o que reduz em 4x o tamanho e facilita o armazenamento e a transmissão.

Considerações finais: um novo paradigma para observação da Terra

O AlphaEarth Foundations abre uma nova categoria: a dos modelos fundacionais geoespaciais.

Assim como os LLMs estão transformando o acesso à linguagem, modelos como o AEF prometem democratizar o uso de dados de satélite e outras fontes ambientais.

Com ele, pequenos conjuntos de dados anotados passam a ser suficientes para gerar mapas precisos em escala global.

E isso tem impacto direto na forma como lidamos com mudanças climáticas, agricultura, gestão hídrica e biodiversidade.

É um avanço técnico, mas também “filosófico”: passamos a representar o planeta não mais como pixels isolados, mas como campos vetoriais vivos, que integram tempo, espaço, sensores e semântica.

Se você curte engenharia, deve estar babando, assim como eu (risos).

Fique atento e nos acompanhe caso queira estar na fronteira dos desenvolvimentos com Inteligência Artificial.

A Tecnologia não vai retroceder, não ignore IA!